はじめに

自動運転という言葉を一般的によく耳にするようになってから、10年ほど経ちました。この数年間、我々は自動運転技術が大きく発展する様子を目の当たりにしながら、一方でその完成に至るまでの道のりの長さも徐々に認識を改めてきました。現在、日本国内ではレベル3の自家用車が市場に投入され始め、高速道路でのレベル4の実現も2025年以降が目標とされている状況ですが、完全自動運転のレベル5に到達するまでには、まだまだ時間がかかりそうな印象です。

自動運転の実現に向けた課題には、「法規制や国際的なルール作り」「コネクテッド技術などによる情報共有のための共有インフラの整備、及び、それに伴う車両のセキュリティ技術」「AI技術の完成度」などをはじめとするさまざまな課題があります。本コラムではこのうち、AI技術の向上に関する課題、及び、その課題を解決するソリューションを紹介します。

自動運転車におけるAI(人工知能)の活用方法

自動運転車の機能は「認知・判断・制御」に大別することができます。このすべてでAIを使用したアルゴリズムが使用されていると考えている方もいるようですが、実はそうではありません。AIは主に「認知」の部分で使用されています。人が車を運転する場合、人が目で見て自車両の周囲の状況を把握したうえで車両を制御します。この「目で見て周囲の状況を把握する」部分に相当する働きをするのが「認知アルゴリズム」です。普段当たり前のように使っている人間の目や脳ですが、これらの機能をルールベースのプログラムで実装するのはかなり困難です。AIを使用しないルールベースのプログラムでは、発生し得る状況をすべて想定しプログラムを組む必要がありますが、車の運転では、他車両や歩行者に加えて、動物の出現や落下物の回避など、想定しなければいけない状況が多岐にわたるため、ルールベースのプログラムを組むことが困難です。そのため、「認知アルゴリズム」では実際に発生し得る走行状況をデータとして用意し、そのデータを使用して各種シチュエーションで物体を認識できるようにAIをトレーニングしています。

AI(人工知能)のトレーニング方法

AIのトレーニングは、通常静止画像に各種タグ付けしたデータを使用して実施されます。例えば、人間は、図1のような画像を見た場合、画像のどの部分に車両があり、どの部分に人が写っているかを認識できますが、未学習のAIにはそれができません。そこでAIをトレーニングする際には、元画像と一緒に画像内のオブジェクトにタグ付けした画像データをAIに入力します。AIはタグの情報を見ることによって画像のどの部分にどのようなオブジェクト(車両や人)があるのかを認識することができ、オブジェクトの特徴を学習することができます。これが自動運転車に搭載されているAIのアルゴリズムを構築する方法です。

図1:AI学習データサンプル例

タグ付けをする要素のひとつに「セマンティック・セグメンテーション」があります。「セマンティック・セグメンテーション」では、図2のようにオブジェクトを色分けし、配色とオブジェクトの情報を入力することで画像内のどこにどのようなオブジェクトがあるのかをAIに教えます。このようなデータを元画像と一緒にAIに入力することで画像内にあるオブジェクトの情報をAIに学習させることができます。

図2:図1の画像に対応するセマンティック・セグメンテーションデータ

AI(人工知能)用学習データの収集方法

AIの学習には、車両に搭載されたカメラで撮影した画像とその画像にタグ付けするための情報を含むデータが使用されます。一方で走行時にはフロントガラスの破損や動物の飛び出しなど事故に繋がり得る特殊なケースに遭遇することは稀なため、通常実走行時の画像と併用して特殊なケースを模擬したCG画像が使用されます。

図3:特殊なケースの例

AI(人工知能)学習用CG画像の課題

近年ゲームエンジンのレンダリング技術の向上により、CG画像の質は大幅に向上しましたが、それでもCG画像で学習したAIでは現実の世界を認識できないという話を認知アルゴリズムの開発者からは聞きます。この理由としては以下の二つが考えられます。

- CG画像生成時に使用されるシステムの中に現実の世界を模擬するための物理モデルが搭載されていないため、現実世界の光の反射・拡散・回折を反映したCG画像を生成できない。

- CG画像生成時に使用されるカメラのセンサーモデルが実カメラを正しく模擬できていないため、生成されたCG画像がカメラの特性を加味したものとなっていない。

これらの課題はCG画像を「認知アルゴリズム」の学習に使用するうえでの大きな障壁となっており、特殊な状況を「認知アルゴリズム」に学習させる際の妨げとなっています。

現実の世界を模擬可能なCG画像提供サービス「Anyverse」

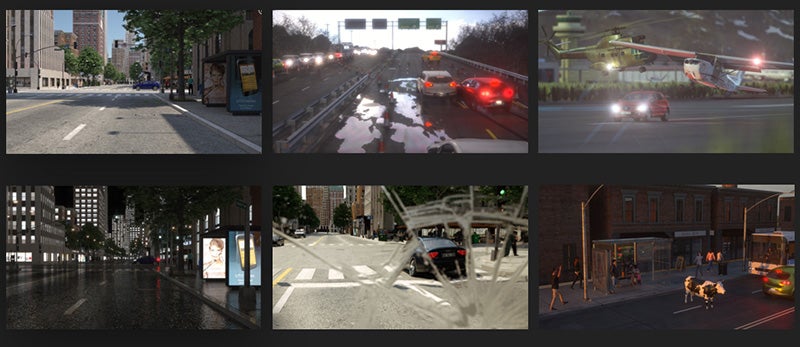

このような課題を解決するために開発されたサービスが、スペインAnyverse社が手掛けるCG画像提供サービスです。Anyverseが開発したレンダリングエンジンには、レイトレーシング(光線追跡法)技術が採用されており、現実世界の光の反射・拡散・回折を模擬したCG画像を生成することができます。

図4:レイトレーシング技術イメージ図

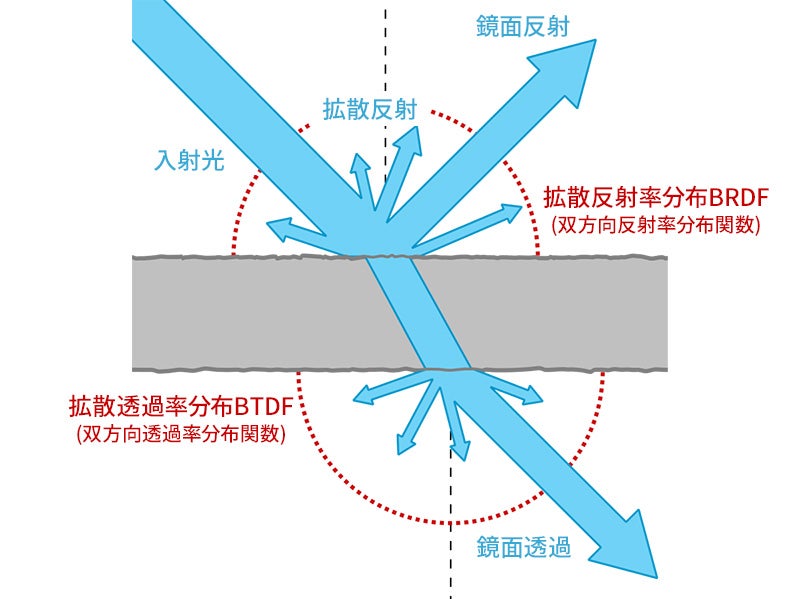

またレンズ、イメージセンサー、画像処理など、デジタルカメラの特性を加味したCG画像を生成することができます。

図5:一般的なデジタルカメラの構造概略図

Anyverse (機械学習用CG画像提供サービス)

AD(自動運転)/ADASの認知アルゴリズムに使用するAI(人工知能)の機械学習用のCG画像を提供します。お客様の要求に合わせて、実走行では撮影が困難なコーナーケースや特殊な状況などのCG画像をお客様毎にカスタマイズして作成することが可能です。CGで作成するため、車/歩行者/信号/植生などをミスなく高品質にラベリングしたデータも提供でき、認知アルゴリズム開発のためのAI機械学習を効率的に行うことが可能です。

東陽テクニカでは、お客様のニーズに応じて現実世界を模擬したCG画像とタグ付けしたデータをセットで提供しております。カメラだけではなくLiDARの学習データを提供することも可能です。自動運転車開発に欠かせないAI(人工知能)をより効果的に活用するためのお手伝いをしていきたいと考えています。